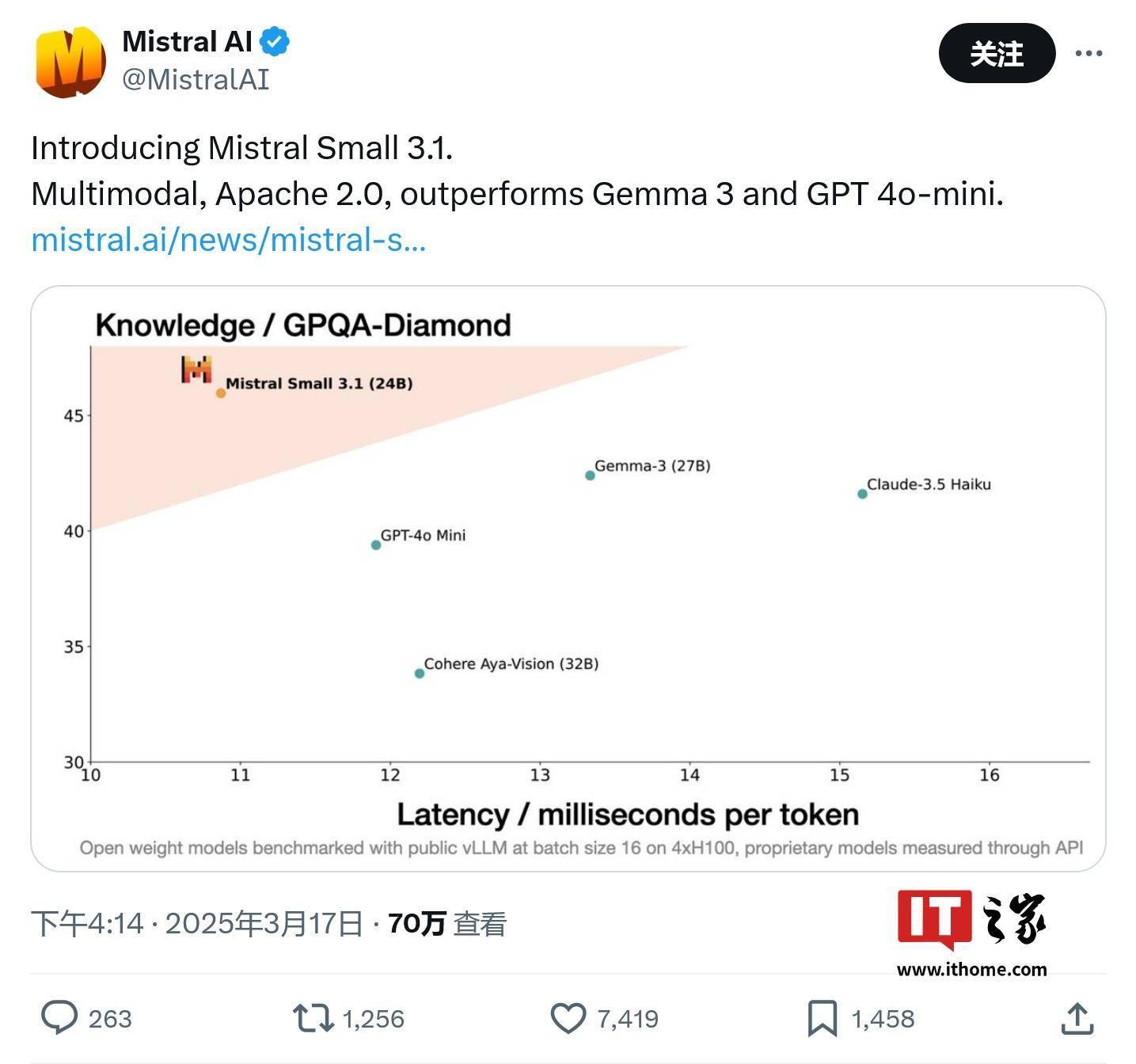

3 月 19 日消息,Mistral AI 公司于 3 月 17 日发布博文,推出最新 Mistral Small 3.1 模型,240 亿参数,128K 上下文,不仅能在本地运行,降低成本,而且部分性能超过 OpenAI 的 GPT-4o mini。

援引博文介绍,Mistral Small 3.1 主打高效运行,可以在单张 RTX 4090 显卡的 PC 或者 32GB 内存的 Mac 上本地运行,适用于虚拟助手等需要快速、准确响应的应用,让其成为预算有限的中小型企业和开发者的理想选择。

该模型无需依赖云端 AI 模型,支持本地数据处理,从而降低了敏感信息泄露的风险。该模型还支持调用低延迟函数,能够在自动化或代理工作流程中快速执行函数。

Mistral Small 3.1 可用于各种需要多模态理解的企业和消费者应用,例如文档验证、诊断、设备端图像处理、质量检查视觉检测、安全系统中的对象检测、基于图像的客户支持和通用助手。

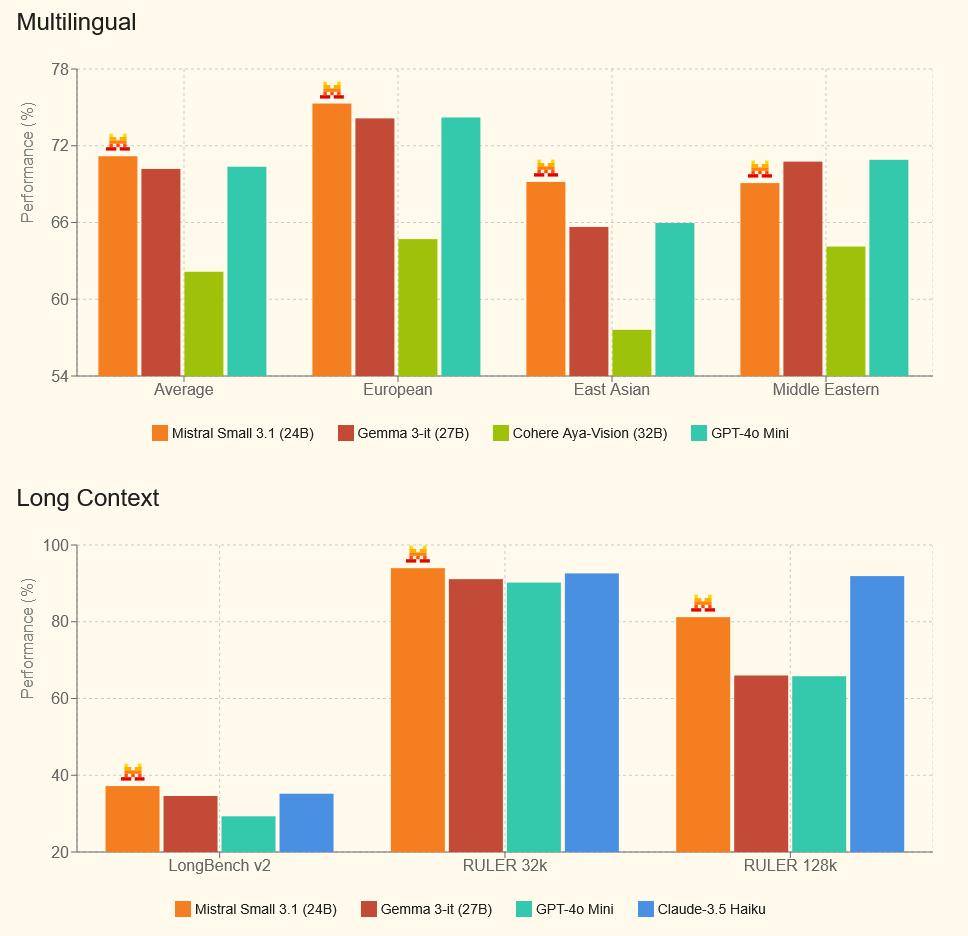

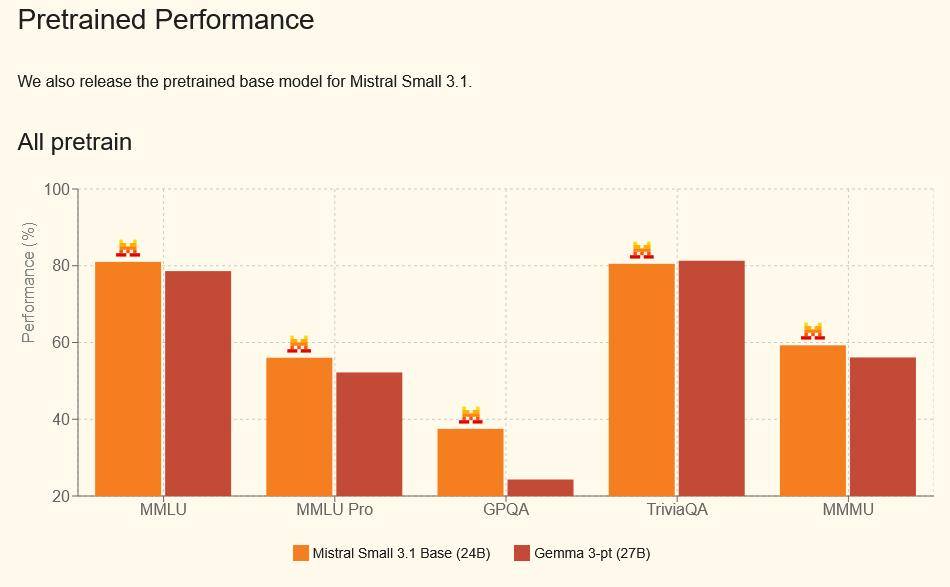

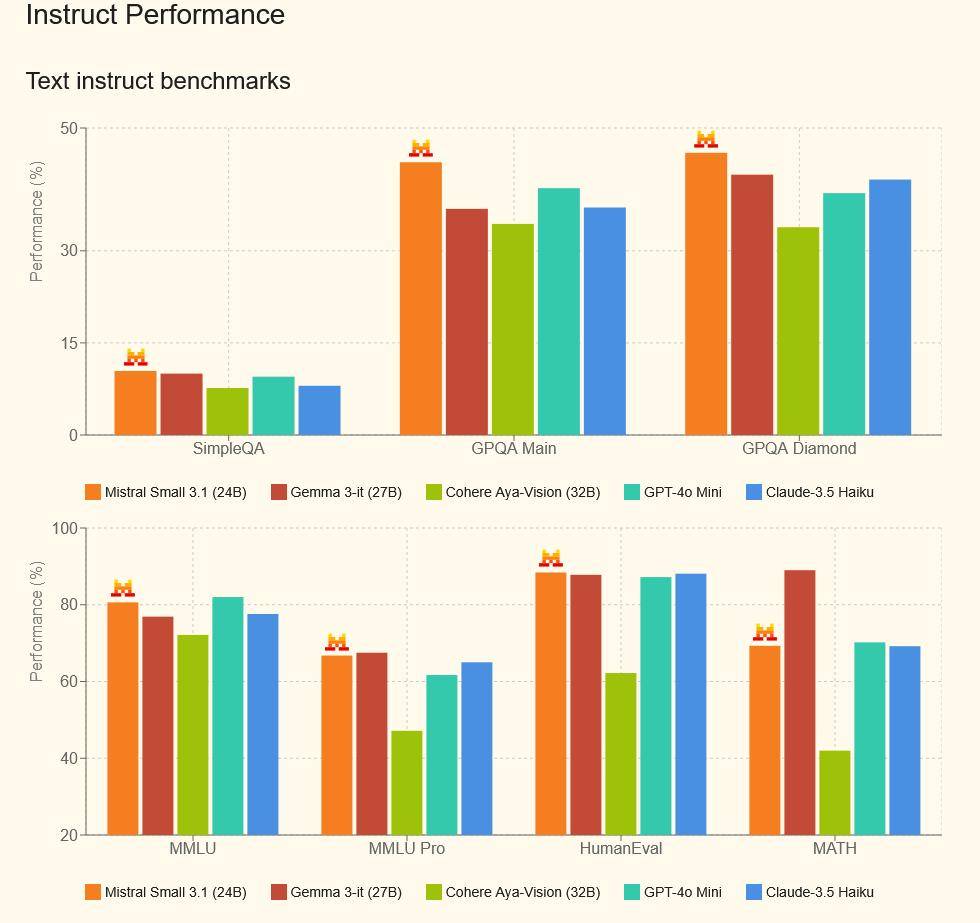

Mistral Small 3.1 在多个基准测试中表现出色,在多语言理解、长文本处理和多模态指令跟随等方面都展现了强大的能力。

在多语言理解方面,Mistral Small 3.1 优于 Gemma-3、Cohere Aya-Vision、GPT-4o Mini 和 Claude-3.5 Haiku 等模型。

在处理视觉和文本信息方面,Mistral Small 3.1 在视觉推理、图表信息提取和图解分析等方面表现出色,推理速度最高可以实现每秒 150 个 tokens。

在问题解答、知识检索、代码生成和数学问题解决等任务中,Mistral Small 3.1 展现了强大的能力。

免责声明:本网信息来自于互联网,目的在于传递更多信息,并不代表本网赞同其观点。其内容真实性、完整性不作任何保证或承诺。由用户投稿,经过编辑审核收录,不代表头部财经观点和立场。

证券投资市场有风险,投资需谨慎!请勿添加文章的手机号码、公众号等信息,谨防上当受骗!如若本网有任何内容侵犯您的权益,请及时联系我们。

相关文章

-

史上最贵苹果手机!曝折叠屏iPhone最快明年量产上市

2025-03-1911阅读

-

腾讯元宝近一个月日活激增超 20 倍,此前已接入 DeepSeek

2025-03-1911阅读

-

美国康奈尔大学研发AI智能戒指:可利用微型声纳技术识别手语拼写

2025-03-1911阅读

-

香港杠反ETF进入个股时代,南方东英率先下注,华夏、博时将跟进

2025-03-1911阅读

-

国家邮政局对上海韵达货运立案调查,涉诈骗宣传品寄递问题

2025-03-1911阅读

-

永诺 35mm F1.8R DA DSM 镜头官宣 3 月 25 日 699 元首销

2025-03-1911阅读

-

小鹏汇天“陆地航母”飞行汽车适航审定取得进展

2025-03-1911阅读

-

马化腾:希望成为所有机器人厂商的合作伙伴 并非取而代之做硬件

2025-03-1911阅读

-

腾讯单季营收1724亿:年度派息410亿港元 马化腾称加大AI投入

2025-03-1911阅读

-

存5年不如存3年?银行长短期利率倒挂,有中小银行3年期定存利率仍接近3%

2025-03-1911阅读