人形机器人进厂打工早就不是新鲜事了,但有勇气一镜到底公开展示的目前也就 Figure 一家。

就在今天,Figure 发布了一部长达 1 小时的视频,邀请全网监工机器人 Figure 02 分拣快递。在视频当中,Figure 02 要完成这样四项工作:

拿起左手边的快递;找到并扫描快递包装上的快递单;将快递单朝下放置到右手边的传送带上;甚至可以轻轻拍一下包裹,保证平整。

但是,这项工作的难点至少有三个:

快递包装的种类繁多(纸盒,包裹袋,文件袋等),且五颜六色,不同的包装分别应该怎么抓?如何准确找到快递单的位置?如何保证更高的准确率,工作中少出错?这三个难点,Figure 的就是用此前发布的 Helix 神经网络解决的。今早,Figure 在官网上线了一篇文章,总结了此前 10 - 60 小时训练期间的数据变化,对一个小时的视频做了详细解读。Figure 02 之所以能这么强,秘诀就在于视觉记忆、状态历史以及力反馈这三个关键词。并且,最后还有个彩蛋,如果机器人工作的时候,有人伸手了,机器人会怎么办?

平均 4 秒处理一个包裹

从能力上看,Figure 02 在处理快递包裹的时候,已经表现出了不错的成熟度,具体就表现在工作流的四个环节当中。

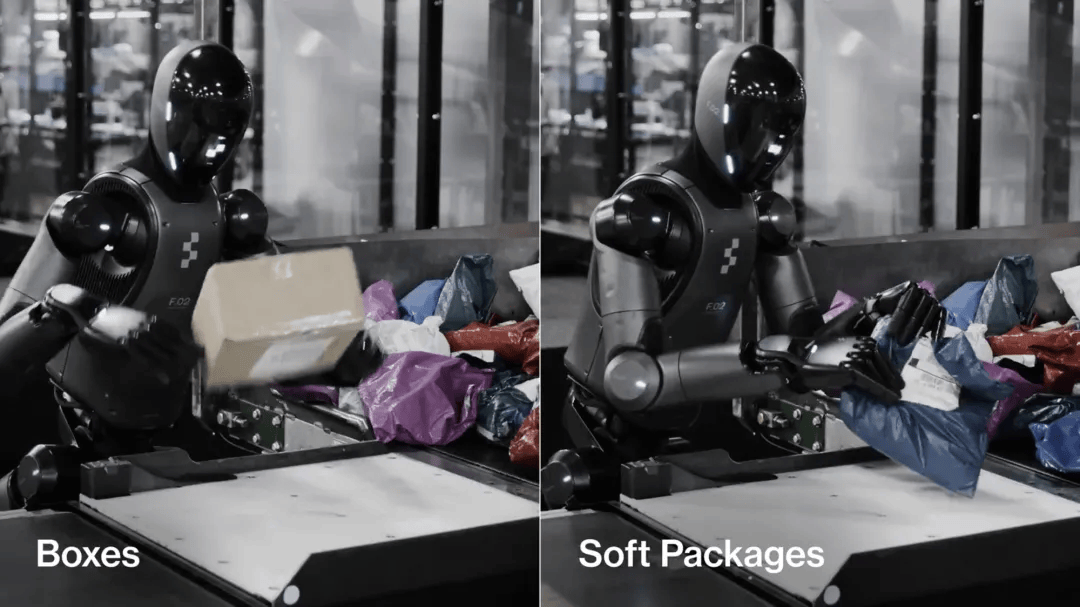

Figure 02 可以处理不同形状的快递包裹,最简单的是纸箱,但更难的是塑料袋包裹、文件袋以及其他容易产生形变的包裹。由于这些包裹容易折叠、起皱或者弯曲,就让抓取和快递单的定位更困难。基于 Helix 神经网络,Figure 02 就能动态调整抓取策略,最终处理一件包裹的平均时间为 4.05 秒,快递单条码的定位成功率提升到接近 95%。

另一方面,在将包裹翻转之后,Figure 02 手上还有个微动作——轻轻拍一下包裹,将其抚平。实际上,在学习过程中,这一动作并非强制,而是机器人在端到端学习之中总结出来的方法。

神经网络的三大改进

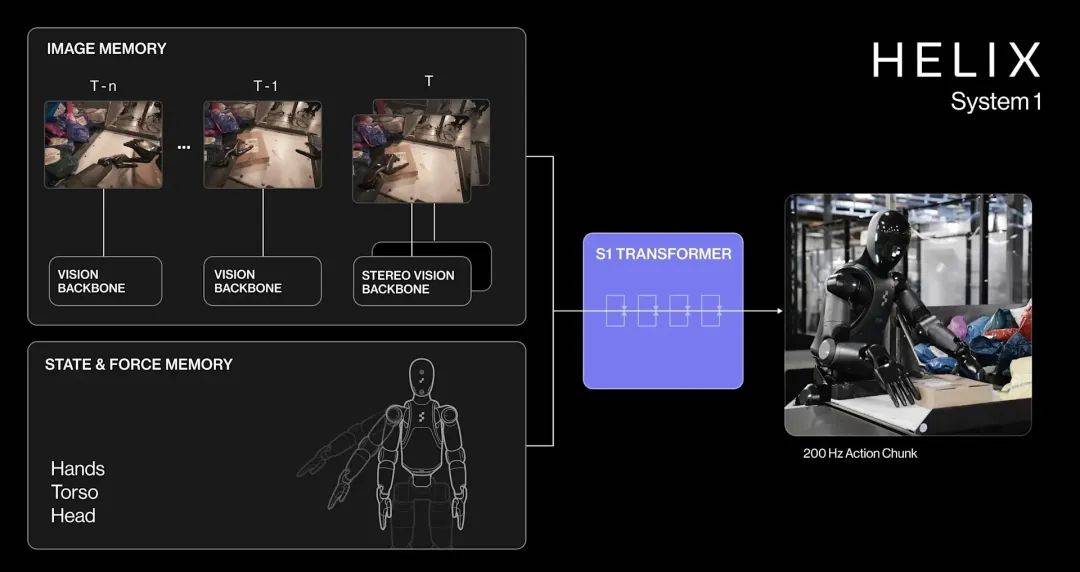

Figure 02 为什么能做到这么高的效率?答案在于 Helix 神经网络对系统 1 视觉运动策略的改进。在过去两个月时间里,Figure 引入了视觉记忆、状态历史以及力反馈三个模块,能够让 Helix 神经网络更好地感知外部世界随时间的变化,并且感受自身行为。这到底是什么意思呢?我们还是要回到 Figure 的工作现场。

在抓取快递包裹之后,如果快递标签不在正上方,Figure 可能要检查包裹的另一面,这时候就需要视觉记忆模块起作用了。

Helix 能够短时间记忆周围环境,从近期的视频帧中合成特征,从而获得场景的时间扩展视图。这样一来, 机器人可以记住它检查过包裹的哪几个侧面,同一个面不会检查两次。

从本质上来说,视觉记忆赋予了 Helix 一种时间上下文感知能力,以视觉记忆为指导,而不是碰运气。这样,Figure 02 实现了更高的工作效率——快递单条码定位成功率接近 95%。

另一个提升工作效率的方式就是让动作连续起来,左右手都不能闲着,Figure 引入了状态历史这一模块。最初,Figure 给机器人的策略是固定时长的动作块(比如在 0.5 秒内伸手);之后,通过将机器人的状态历史纳入策略输入,系统就能让动作块之间连续起来。更重要的是,状态历史保留了前后的视觉记忆,即便重新规划,也不会破坏整个流程的效率。

最终, Figure 02 能够更快地响应意外和干扰,如果包裹抓取失败,Helix 会用最低的延迟纠正其中的运动,这同样提升了包裹的处理效率。

在抓取快递包裹时,还有一大难点在于究竟要用多大的力量抓取包裹?Figure 给出的方案是加入力反馈模块。目前,Figure 02 对环境、物体施加的力已经成为输入神经网络状态的一部分。比如,在机器人伸手拿包裹时,它可以记录下时间,当包裹已经平整放在台面上,手上施加力量也压不动的时候,机器人就会停止向下压包裹。

通过力反馈模块的加入,Figure 02 的成功率与运动一致性再次提高。

如何证明模型有效?

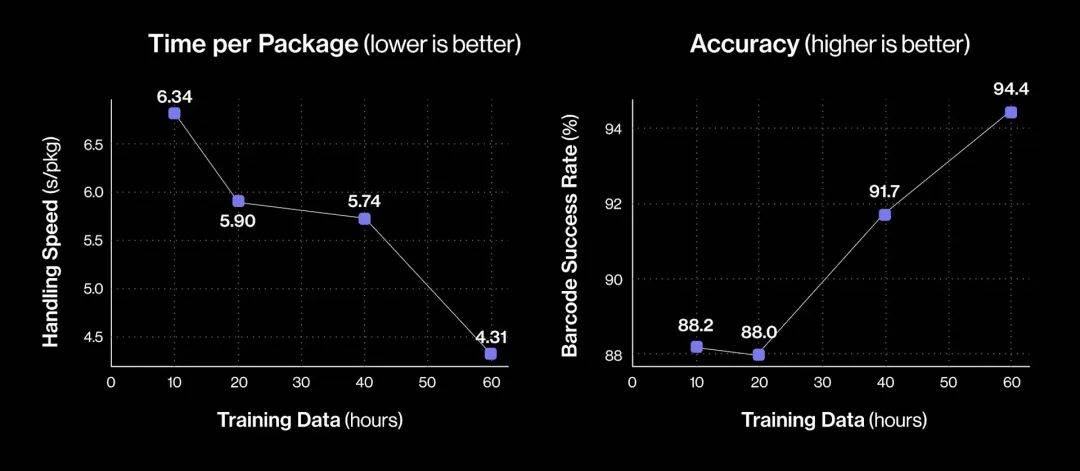

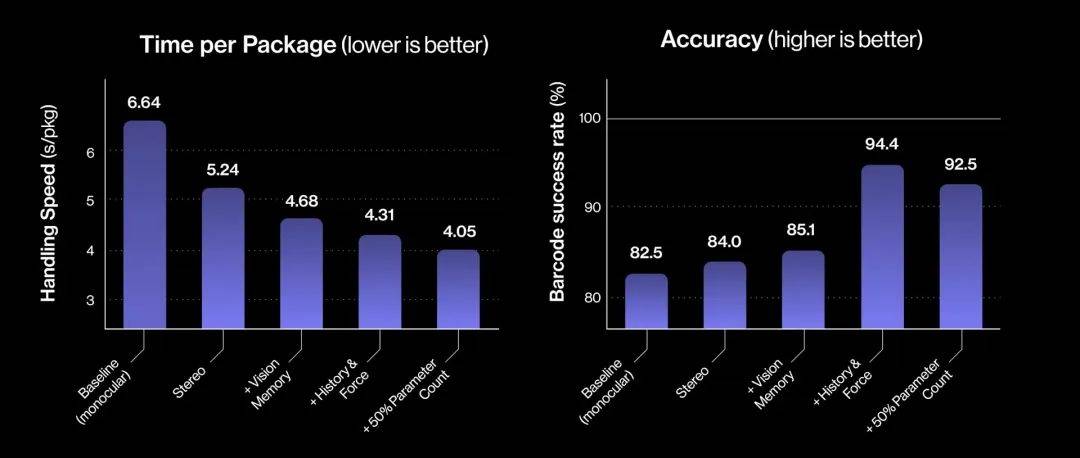

为了量化 Helix 改进对 Figure 02 能力的提升,研究人员针对不同的方案进行了训练,最后结果就看两个数据,一个是包裹的处理速度,另一个是快递单扫描的成功率。

第一个控制控制变量实验是研究训练时间与模型熟练程度的关系。研究人员分别在 10、20、40、60 小时时记录模型的能力。结果发现,在训练 10 小时后,包裹处理的速度为 6.34 秒,而在训练 60 小时后,包裹的处理速度为 4.31 秒,速度快了 58%。同时,快递单扫描成功率也从 88.2% 提升到了 94.4%。

这也就说明,未来随着数据规模扩大,模型性能会持续提升。

第二个实验针对视觉记忆、力反馈模块的增加,探究能否提升机器人的工作效率。研究人员有有多组参考,分别是单目视觉、立体视觉、加入视觉记忆、加入状态历史和力反馈、在此前基础上增加 50% 参数量共 5 个对照。

结果表明,在加入视觉记忆后,单个快递的处理时间减少了 0.5 秒;在加入状态历史和力反馈后,识别快递单的准确率从 85.1% 提升至 94.4%。最终,单个快递处理时间为 4.05 秒,准确率 92.5%。

也就是说,这两项实验能够直接证明 Figure 新加入的模块对于提升效率和准确度有很大的帮助。

在最后,Figure 还展示了一个彩蛋,当 Figure 02 认真工作的时候,有个人走到面前伸出手,机器人会认为这是要将包裹交给他的意思。这时候机器人不会将包裹放在传送带上,而是交给对面的人。

这种类人的条件反射非常惊艳,因为还没有第二个机器人能这样与人互动。不过,机器人刚刚进入社会,毕竟还是 Too Young,人伸出手竟然就把东西递出去了,看来他还是不太懂复杂的人类。

免责声明:本网信息来自于互联网,目的在于传递更多信息,并不代表本网赞同其观点。其内容真实性、完整性不作任何保证或承诺。由用户投稿,经过编辑审核收录,不代表头部财经观点和立场。

证券投资市场有风险,投资需谨慎!请勿添加文章的手机号码、公众号等信息,谨防上当受骗!如若本网有任何内容侵犯您的权益,请及时联系我们。

相关文章

-

我国火星原位储能与发电研究获新进展

2025-06-0912阅读

-

无人机为何不能承担珠峰测量工作?

2025-06-0912阅读

-

机器人是否会让人类失去收入

2025-06-0912阅读

-

中国深渊科考,走向世界!

2025-06-0912阅读

-

四问人形机器人(“融”观中国)

2025-06-0912阅读

-

诺基亚宣布主导欧盟 PROACTIF 项目,开发应急管理无人机系统

2025-06-0912阅读

-

特斯拉机器人会不会抢占中国市场?

2025-06-0912阅读

-

中国有哪些企业与特斯拉机器人合作?

2025-06-0912阅读

-

全国各地现“不明飞行物”目击,外星人要来地球,霍金预言成真了

2025-06-0912阅读

-

消息称Vision Pro将全面支持PlayStation、Xbox手柄及空间控制器

2025-06-0912阅读