近期,谷歌在人工智能领域的一项新进展引起了广泛关注。在一则最新播客节目中,一款搭载了Gemini人工智能技术的机器人,在没有事先教导的情况下,成功完成了一次“扣篮”动作,展现了其迅速适应新环境的能力。

这一壮举紧随其在洛杉矶RSS2025(机器人软件与系统大会)上的全球首次互动式现场展示。会上,运行着Gemini Robotics On-Device模型的机器人吸引了众多目光。硅谷AI领域的观察者Ted Xiao对此评论道:“这仿佛是对未来的一次神奇预览——只需与机器人进行对话,它就能做出恰当的回应,并尝试执行一系列合理的操作,无论是面对新的物体、命令还是技能。”

Gemini Robotics On-Device模型于6月24日正式发布,这一创新将AI引入了机器人领域,且整个过程中无需持续依赖互联网连接,实现了离线工作。谷歌在X部门强调,这是他们首个“视觉-语言-动作”模型,旨在帮助机器人更快、更高效地适应各种新任务和新环境。

回顾今年早些时候,Figure公司发布的“历史上最重大的人工智能更新”——Helix,同样是一款专注于通用人形机器人控制的“视觉-语言-动作”(VLA)模型。然而,与Figure的模型不同,谷歌的这款模型能够独立于数据网络运行,这对于对延迟敏感的应用尤为关键,确保了即使在间歇性或无网络连接的环境中也能稳定运行。

事实上,早在今年3月,谷歌就已推出了第一代VLA(视觉语言动作)模型Gemini Robotics,将Gemini 2.0的多模态推理和现实世界理解能力引入物理世界。而此次发布的Gemini Robotics On-Device模型,作为双臂机器人的基础模型,除了极大地减少了计算资源需求外,还主要解决了三个核心问题:灵巧操作、新任务的快速适应以及基于本地运行的低延迟推理。

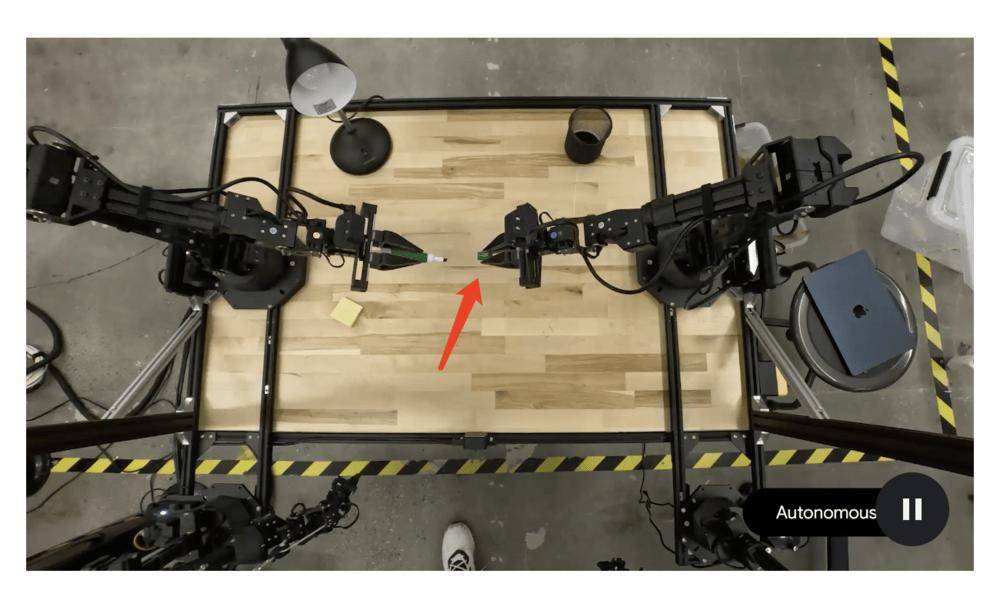

在官方演示视频中,一对灵巧的机械手不仅能够轻松拿起一支笔,还能相互配合拔掉笔盖。随后的测试中,这对机械手成功完成了“放置蓝色砖块”、“拉开中间抽屉”以及“归位‘梨’模型”等任务,仅凭自然语言指令如“Can you close the middle drawer?”(你能关上中间的抽屉吗?)就展现出了强大的视觉、语义和行为泛化能力。

除了演示之外,Gemini Robotics On-Device模型在基础跑分数据上也表现出色。在泛化能力方面,尽管略低于谷歌旗舰Gemini Robotics模型的表现,但仍远超之前最好的离线模型。在分布式任务和复杂多步骤指令方面,该模型也优于其他设备端替代方案。

面对家中无数形状、大小、颜色和纹理各异的物品,机器人需要能够按需产生智能的新行为,尤其是对于那些从未见过的物体。机器人技术的一大挑战在于,举一反三并非易事。而Gemini Robotics On-Device模型通过50到100次演示即可快速适应新任务,展现了其强大的新任务适应能力。

谷歌还展示了这一性能在实际应用中的效果,将其调整并应用到了双臂Franka FR3机器人和Apptronik的Apollo人形机器人上。在Franka机器人上,该模型能够执行通用指令,处理以前未见过的物体和场景,完成包括折叠衣服在内的灵巧任务,以及需要精确度和灵巧性的工业皮带组装任务。在Apollo人形机器人上,通用模型同样能够遵循自然语言指令,以通用的方式操控不同的物体,包括之前从未见过的物体。

这一系列创新引发了网友的热烈讨论。有人认为,谷歌的脱机AI机器人具有改变游戏规则的可能性。然而,也有人提出质疑,询问这与特斯拉机器人的设计有何不同,以及与ylecun在meta所做的工作有何差异。在机器人/具身智能这一赛道上,各家大模型正展现出多样性和丰富性的技术向度,共同指向同一个核心命题——如何让AI在三维物理世界中建立真正的因果认知。

免责声明:本网信息来自于互联网,目的在于传递更多信息,并不代表本网赞同其观点。其内容真实性、完整性不作任何保证或承诺。由用户投稿,经过编辑审核收录,不代表头部财经观点和立场。

证券投资市场有风险,投资需谨慎!请勿添加文章的手机号码、公众号等信息,谨防上当受骗!如若本网有任何内容侵犯您的权益,请及时联系我们。

相关文章

-

成都AI科普展:免费赏“天”字辈机器人,探索智能未来两月行

2025-06-298阅读

-

《天府工匠》燃爆低空蓝海:无人机+有人机“CP”大战

2025-06-298阅读

-

700亿估值芯片独角兽冲刺IPO

2025-06-298阅读

-

【新思想引领新征程】“智慧”城市让生活更美好

2025-06-298阅读

-

学子故事 | 用游戏思维做设计,在月球建家园!一位跨界建筑生的宇宙级浪漫蓝图

2025-06-298阅读

-

探测器传回龙宫照片,这坑坑洼洼的样子,和想象的完全不一样

2025-06-298阅读

-

纯水设备化学药剂管理

2025-06-298阅读

-

探测器传回龙宫照片,这坑坑洼洼的样子,和想象的完全不一样

2025-06-298阅读

-

意大利专家纳闷:中国人是无神论者,为何中国能快速崛起重回巅峰

2025-06-298阅读

-

马斯克公布脑机接口最新进展,受试者有望用意念操控人形机器人

2025-06-298阅读