科技圈又炸了!就在大家还在热议 AI 的无限可能时,谷歌的下一代王牌——Gemini 3.0,竟然以一种意想不到的方式悄悄露出了冰山一角。

Gemini 3.0惊现代码库

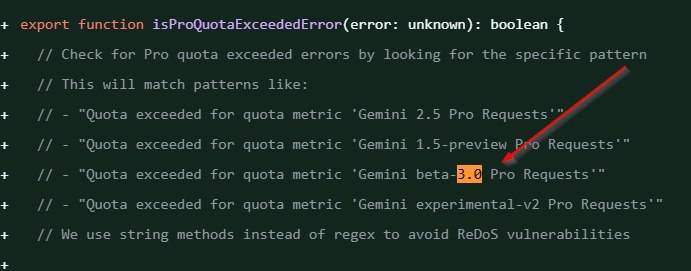

近日,有眼尖的开发者在谷歌官方的 GitHub 代码库中发现了一条不寻常的提交记录。

在这条针对 Gemini 命令行工具的记录中,赫然出现了 “Gemini 3.0 Flash Beta” 与 “Gemini 3.0 Pro Beta” 这两个全新的模型名称。

这一发现几乎是实锤了:尽管谷歌官方三缄其口,但其下一代核心 AI 模型早已在紧锣密鼓地开发中!

不止一次的“意外”泄露

这已经不是谷歌第一次“不小心”了。

不久前,谷歌就曾意外发布了一篇关于 Gemini CLI(命令行工具)的博客文章,随后又迅速将其下线变为404页面。那次短暂的曝光透露了 Gemini CLI 的多项关键功能,例如:

• 超大上下文窗口:支持高达100万代币的上下文,能轻松处理复杂的代码和海量数据。

• 超高免费额度:提供每分钟60次、每日1000次的免费请求配额,堪称业界最高。

• 强大集成能力:集成了谷歌搜索功能以获取实时信息,并与 VS Code 深度集成,优化开发流程。

从命令行工具的功能泄露,到如今 3.0 版本的型号曝光,这些蛛丝马迹都指向同一个事实:谷歌正在憋一个 AI 大招。

能力越强,安全越重要

当然,随着模型能力越来越强大,用户对 AI 的安全与隐私问题也愈发关注。毕竟,任何人都担心生成式 AI 可能产生有害内容、泄露敏感信息或被滥用。

对此,谷歌也早已构建了全面的安全体系。通过其 Vertex AI 平台,谷歌为 Gemini 模型部署了多层安全防线,以应对内容风险、品牌风险和隐私风险等挑战。

其具体的安全工具和策略包括:

• 可配置的内容过滤器:用户可以为色情、仇恨言论等有害内容设置不同的屏蔽阈值。

• 系统指令:开发者可以直接引导模型应有的行为和需要避开的话题。

• 数据泄露防护 (DLP):专门用于防止模型泄露敏感数据,并支持自定义屏蔽列表。

• 将 Gemini 作为过滤器:利用 Gemini 模型本身(如 Gemini Flash)进行二次调用,以评估和过滤内容,提供更高级和定制化的安全检查。

你的数据,谷歌如何处理?

在隐私方面,谷歌的隐私权声明提到,为了提升服务质量,部分对话内容会由经过培训的人工审核员进行审核和批注。不过,谷歌强调会在此过程中采取措施保护用户隐私,例如在审核员查看前,会将对话内容与用户的谷歌账号解除关联。

如果你不希望自己的对话被用于改进模型,可以随时在设置中关闭“Gemini 应用活动记录”。但需要注意的是,即便关闭了该记录,为了维护服务和处理反馈,你的对话内容仍会在账号中最多保留72小时。

展望未来 从代码库的意外泄露,到 CLI 工具的惊鸿一瞥,再到背后严密的安全与隐私框架,Gemini 3.0 的轮廓正变得越来越清晰。

这次“泄露”无疑再次点燃了 AI 领域的战火,也让我们对谷歌的下一步充满了期待。虽然距离官方正式发布或许还需时日,但一场由 Gemini 3.0 引领的 AI 新风暴,可能已经不远了。

你怎么看谷歌这次的“意外”泄露?你对 Gemini 3.0 有什么期待?欢迎在评论区留言讨论!

免责声明:本网信息来自于互联网,目的在于传递更多信息,并不代表本网赞同其观点。其内容真实性、完整性不作任何保证或承诺。由用户投稿,经过编辑审核收录,不代表头部财经观点和立场。

证券投资市场有风险,投资需谨慎!请勿添加文章的手机号码、公众号等信息,谨防上当受骗!如若本网有任何内容侵犯您的权益,请及时联系我们。

相关文章

-

科技平权落地,深蓝S07激光版城区NCA重塑20万级标杆

2026-04-07198阅读

-

联想ThinkPad 2026新品暨天禧AI生态发布活动定档4月22日

2026-04-07198阅读

-

畅享90 Pro Max抢先体验,鸿蒙版高德地图业内首发系统级“智能路况提醒”

2026-04-07198阅读

-

“Claude Code更新废了”!思考深度降67%,无法胜任复杂工程任务

2026-04-07198阅读

-

朋友圈装富豪成产业链:这种“市场需求”不该被满足丨中听

2026-04-07198阅读

-

英伟达全新架构带动PCB用量增长2~3倍 同宇新材“20CM”涨停

2026-04-07198阅读

-

一季度累计上牌量11637台!零跑登顶意大利纯电市场销量榜

2026-04-07198阅读

-

西部证券:AI算力爆发推动光模块技术向高集成度演进

2026-04-07198阅读

-

鬼手想点谁就点谁?LaSM让GUI智能体把注意力「收回来」

2026-04-07198阅读

-

USC团队发布HumDex:攻克人形机器人数据瓶颈,低成本灵巧操控

2026-04-07198阅读